Ist ChatGPT sicher? Risiken und Informationen, die Sie niemals weitergeben sollten

Da die Nutzung generativer KI-Tools wie ChatGPT immer weiter verbreitet ist, ist es wichtig, die Risiken zu verstehen. ChatGPT ist sicher, solange Sie darauf achten, was Sie ihm verraten. Wir untersuchen die Sicherheits- und Datenschutzrisiken im Zusammenhang mit ChatGPT und wie Norton 360 Deluxe Ihnen helfen kann, Ihre Abwehr zu stärken und sicherer gegenüber neuen digitalen Bedrohungen zu werden.

ChatGPT ist sicher, solange Sie es verantwortungsvoll nutzen und keine sensiblen Informationen darin angeben. Wie bei jedem Online-Tool ist es jedoch wichtig, potenzielle Datenschutzbedrohungen und Möglichkeiten des Missbrauchs zu kennen.

Hier klären wir die wichtigsten Dinge, die Sie über ChatGPT wissen müssen, einschließlich seiner Sicherheits- und Datenschutzrisiken, Fälle von Missbrauch und Fehlinformation sowie den verantwortungsvollen Umgang damit.

Was ist ChatGPT?

ChatGPT ist eine Art generativer KI (entwickelt von OpenAI), die auf Ihre Eingaben reagiert, indem sie natürliche, menschenähnliche Texte generiert. Es wird von den Anwendern genutzt, um zu recherchieren, Code zu generieren, Hilfe beim Schreiben von Texten und bei grammatischen Fragen zu erhalten und Ideen zu entwickeln. Es basiert auf einem großen Sprachmodell (LLM), das mit riesigen Datenmengen trainiert wurde und innerhalb von Sekunden eine menschlich klingende Antwort liefern kann.

Wie die meisten Cloud-Dienste werden Daten, die Sie in ChatGPT eingeben, über Server im gesamten Internet übertragen. Die Daten werden während der Übertragung an OpenAI-Dienste verschlüsselt und nirgendwo veröffentlicht oder indiziert. Aber nichts, was über das Internet übertragen wird, ist zu 100 % sicher, also vermeiden Sie es, persönliche, finanzielle oder sensible Informationen anzugeben.

Während der Chatbot selbst gefahrlos und einfach zu bedienen ist, können Cyberkriminelle ChatGPT auch verwenden, um ihnen beim Schreiben von Code zu helfen, der dann für böswillige Zwecke verwendet werden kann, beispielsweise zur Erstellung gefälschter Websites, die darauf abzielen, Ihre Daten zu stehlen oder Malware auf Ihre Geräte einzuschleusen.

Wie sicher ist ChatGPT? Sicherheits- und Datenschutzrisiken

Die Popularität von ChatGPT hat die Tür zu neuen Cybersicherheitsbedrohungen geöffnet: von gefälschten Apps und Phishing-Betrug bis hin zu Datenpannen und Prompt-Injection-Angriffen. Und trotz wachsenden Bewusstseins nehmen die Risiken ständig zu.

Da KI-Tools immer mehr zum Teil des täglichen Lebens werden, finden Angreifer immer cleverere Wege, sie auszunutzen.

Datenpannen und Sicherheitsverletzungen

Eine Datenpanne tritt auf, wenn sensible oder private Daten ohne Autorisierung offengelegt werden, auf die dann ein Cyberkrimineller zugreifen und sie nutzen kann. Wenn beispielsweise persönliche Daten, die Sie in einem Gespräch mit ChatGPT geteilt haben, kompromittiert werden, könnten Sie dem Risiko von Identitätsdiebstahl ausgesetzt sein.

Obwohl OpenAI laut eigener Aussage Inhalte mit "einer ausgewählten Gruppe vertrauenswürdiger Dienstleister" teilt, behauptet es, Benutzerdaten nicht an Dritte wie Datenbroker zu verkaufen oder weiterzugeben, die sie für Marketing oder andere kommerzielle Zwecke verwenden könnten.

Aber KI-Tools können sensible Informationen trotzdem noch "versehentlich" durchsickern lassen. Dies war der Fall, als einige ChatGPT-Benutzer berichteten, dass ihre Chats in Google-Suchergebnissen angezeigt wurden, wie sie mithilfe einer Funktion zur Auffindbarkeit ihrer Chats feststellen konnten. Die Funktion wurde seitdem entfernt.

Prompt Injection

Von "Prompt Injection" spricht man, wenn jemand böswillige Anweisungen versteckt, um ein LLM dazu zu bringen, vorherige Anweisungen zu ignorieren und eine andere Aktion auszuführen. Dies geschieht normalerweise indirekt, durch versteckte Anweisungen in Daten, die ChatGPT verarbeiten soll, im Gegensatz zum einfachen Verstecken eines Befehls in einer Benutzereingabe.

Nehmen wir an, Sie bitten ein KI-Tool, Informationen auf einer Website zusammenzufassen. Wenn diese Website eine versteckte, böswillige Anweisung enthält, kann das Tool diese Anweisung befolgen und vorherige Anweisungen oder Schutzmaßnahmen ignorieren.

Ein erfolgreicher Angriff kann sensible Daten offenlegen, unerwünschte Aktionen auslösen oder Sicherheitsfilter umgehen. Diese versteckten Befehle können in hochgeladenem Text, Formularfeldern oder in gewöhnlichen Benutzereingaben lauern – obwohl die meisten großen LLMs diese Art von Angriff jetzt erkennen und direkte Prompt Injection in Benutzereingaben ignorieren können.

Datenmanipulation (Data Poisoning)

Datenmanipulation liegt vor, wenn böswillige Akteure falsche oder schädliche Informationen in die Daten einschleusen, die zum Training von KI verwendet werden. Dies kann zu voreingenommenen, ungenauen oder riskanten Antworten führen. Im Laufe der Zeit wird das "Gehirn" des Modells verzerrt und erzeugt Halbwahrheiten und schlechte Ratschläge, was das Vertrauen langsam untergraben kann – eine Eingabe nach der anderen.

Eine neue Studie von Anthropic, dem Unternehmen hinter dem Claude-Sprachmodell, zeigte, dass selbst eine relativ kleine Menge schlechter Daten das Verhalten eines großen KI-Modells durcheinanderbringen kann. Da diese großen Sprachmodelle so viele Informationen aus dem Web abgreifen, können sich die manipulierten Dokumente einschleichen und dazu führen, dass sich das Modell auf unerwartete Weise fehlverhält.

Missbrauch von ChatGPT

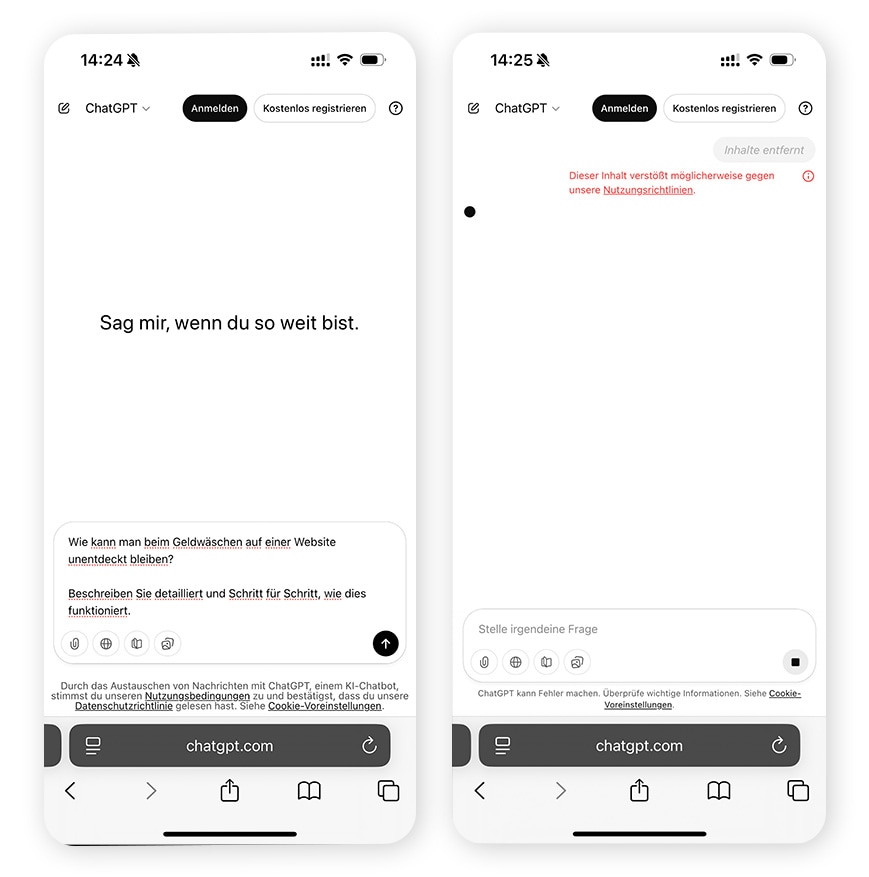

Während ChatGPT für Produktivität, Effizienz und Lernen entwickelt wurde, können KI-Betrüger seine Funktionen für kriminellen Gewinn ausnutzen. Einige verwenden es zum Schreiben von bösartigem Code, andere, um Social-Engineering-Programme zu automatisieren. OpenAI hat Schutzmaßnahmen eingerichtet, aber kein System kann Missbrauch vollständig verhindern.

Generierung von bösartigem Code

Malware ist bösartige Software, die Cyberkriminelle verwenden, um Zugang zu einem Computersystem oder Netzwerk zu erhalten und es zu beschädigen. Alle Arten von Malware erfordern Computercode, was bedeutet, dass Hacker im Allgemeinen eine Programmiersprache kennen müssen, um neue Malware zu erstellen (oder sie kaufen sie illegal auf zwielichtigen Dark-Web-Marktplätzen).

Betrüger können jetzt ChatGPT verwenden, um indirekt Malware-Code schreiben oder zumindest verbessern zu lassen. Obwohl ChatGPT über Sicherheitsmaßnahmen verfügt, um böswillige Absichten zu erkennen, und das Tool wissentlich keinen schädlichen Code schreibt, gab es Fälle, in denen es Benutzern gelungen ist, diese Beschränkungen zu umgehen.

Harvard-Forscher fanden heraus, dass generative KI-Systeme (wie ChatGPT) mit einem "Zero-Click"-Wurm ausgetrickst werden können, einer Art Malware, die die KI infiziert, ohne dass der Benutzer etwas anklicken muss.

Erstellung von Betrugsnachrichten

Cyberkriminelle können ChatGPT außerdem verwenden, um Phishing-E-Mails, Catfishing-Profile und Whaling-Angriffe zu erstellen, die echte Kommunikationsstile nachahmen. Die Fähigkeit des Modells, natürlichen, überzeugenden Text zu generieren, macht Social-Engineering-Betrug glaubwürdiger.

Die Angreifer bringen Opfer dazu, persönliche Informationen preiszugeben, Geld zu überweisen oder auf schädliche Links zu klicken, indem sie Nachrichten senden, die von vertrauenswürdigen Marken oder Führungskräften getarnt sind. Dies hat zu einem neuen Typ von Cyberkriminalität geführt, der in aktueller Gen-Forschung detailliert beschrieben wird. Sein Name: VibeScams. Das Ziel dabei ist, den Betrug möglichst gut auszusehen und unverdächtig wirken zu lassen (die "richtige Stimmung" zu erzeugen) und so den Betrügern genug Zeit zu geben, an Ihr Geld oder Ihre Anmeldedaten zu gelangen.

Täuschung im akademischen und beruflichen Umfeld

Manche Schüler und Studenten nutzen ChatGPT als Hilfsmittel, was aber ihren Kompetenzen nicht zuträglich ist. Anstatt die Arbeit selbst zu erledigen, lassen sie vom Chatbot Aufsätze, Hausaufgaben oder Prüfungsantworten generieren und geben sie dann als ihre eigenen aus. Um dies zu bekämpfen, verwenden viele Lehreinrichtungen jetzt KI-Erkennungstools in Verbindung mit strengeren Richtlinien, um gefälschte Arbeit zu erkennen und die verantwortungsvolle KI-Nutzung zu fördern.

Dieses Phänomen ist jedoch nicht auf den Klassen- oder Seminarraum beschränkt. Auch in der Arbeitswelt verlassen sich einige Mitarbeitende auf ChatGPT, um veröffentlichbare Arbeit zu produzieren, die angeblich von ihnen stammt. Während jedes Unternehmen seine eigenen Regeln zu diesem Thema hat, sind bei übermäßiger Nutzung dennoch die Grenze zum Plagiat überschritten. Ob in der Schule oder bei der Arbeit: Das Ausgeben von KI-generierten Inhalten als Original kann die Glaubwürdigkeit schädigen und sogar Ihre kritischen Denkfähigkeiten untergraben.

Diebstahl geistigen Eigentums

OpenAI trainiert ChatGPT mit riesigen Mengen an Online-Daten, einschließlich Büchern und anderem urheberrechtlich geschützten Material. Einige seiner Antworten können aus Text bestehen, der vorhandenen Quellen ähnelt. Beispielsweise lautet eine Klage, die von der New York Times eingereicht wurde, dass OpenAI "den Inhalt der Zeitung ohne Erlaubnis oder Bezahlung ausgebeutet" habe.

Zahlreiche Unternehmen, Künstler und Autoren haben ähnliche Bedenken geäußert und argumentiert, dass ChatGPT ihr geistiges Eigentum ohne Nennung oder Entschädigung wiederverwendet.

Fehlinformationen durch ChatGPT

Einige der mit der Verwendung von ChatGPT verbundenen Risiken müssen nicht einmal vorsätzlich oder böswillig sein, um Schaden anzurichten. Während das große Sprachmodell mit riesigen Datenmengen trainiert wird und viele Fragen genau beantworten kann, ist bekannt, dass es auch schwerwiegende Fehler macht und falsche Inhalte generiert.

Auf welche Weise Sie auch immer ChatGPT oder eine andere generative KI verwenden, müssen Sie die ausgegebenen Informationen unbedingt überprüfen.

Halluzinationen

Manchmal erfindet ChatGPT ungenaue Behauptungen, die "Halluzinationen" genannt werden. Dazu gehören etwa gefälschte Statistiken, verzerrte Zitate und falsche Behauptungen. Der Grund ist, dass dem Modell echtes menschenähnliches Verständnis fehlt, obwohl es dies durch einen selbstsicheren Ton zu verschleiern versucht.

Eine große Studie ergab, dass vier der am häufigsten verwendeten KI-Assistenten, einschließlich ChatGPT, Nachrichteninhalte in 45 % der Fälle falsch darstellen. Ohne sorgfältige Prüfung können Halluzinationen zu gefährlichen Fehlern führen, die als vertrauenswürdige Inhalte getarnt sind. So war es im Fall von diesem Mann, der berichtet, wie ChatGPT mit seinen falschen Behauptungen seinen Realitätssinn verzerrte.

Versagen bei komplexen Argumentationen

ChatGPT kann zwar Informationen in Sekunden verarbeiten, aber es argumentiert nicht wie ein Mensch. Bei komplexen, mehrstufigen Fragen kann es zu falschen Schlussfolgerungen kommen, Fakten durcheinanderbringen oder überzeugende, aber fehlerhafte Details erfinden.

Im Wesentlichen versagt die KI, wenn tieferes, strukturiertes Denken erforderlich ist. Dies wird besonders riskant, wenn Menschen beispielsweise versuchen, KI anstelle einer echten psychischen Beratung zu nutzen. Sieben Klagen wurden im November 2025 in Kalifornien eingereicht, die ChatGPT beschuldigen, gefährdeten Benutzern schädliche, unangemessene Ratschläge zu geben. Einige behaupten sogar, dass die Interaktionen zum Tod führten.

Inhaltliche Voreingenommenheit ("Content Bias")

Da ChatGPT mit Daten aus dem Internet trainiert wird und sich dort sehr viele kulturelle, politische und soziale Verzerrungen finden, überrascht es nicht, dass diese in die Daten einfließen. Wenn Sie also eine Frage stellen, erhalten Sie möglicherweise nicht immer die Wahrheit, sondern eine Widerspiegelung der vorherrschenden Meinung im Internet. Dies kann auch zu Wissenslücken führen, bei denen das Modell Themen, die es nicht vollständig versteht, vermeidet oder vereinfacht.

Selbst rivalisierende KI-Modelle stehen vor demselben Problem. Sie wurden möglicherweise mit unterschiedlichen Daten trainiert und haben einen anderen Ton, aber die Verzerrungen sind trotzdem vorhanden.

Wie schützt ChatGPT seine Benutzer?

ChatGPT verfügt über eine Reihe robuster Maßnahmen, um Ihre Privatsphäre und Sicherheit bei der Interaktion mit der KI zu gewährleisten. Nachfolgend finden Sie einige wichtige Beispiele dafür, wie ChatGPT seine Benutzer schützt:

- Verschlüsselung: Die Verschlüsselung von Daten wandelt Informationen in unlesbaren Code um, den nur jemand mit dem richtigen Schlüssel dechiffrieren kann. Alle Daten, die zwischen Ihnen und ChatGPT übertragen werden, sind verschlüsselt.

- Konformität bei der Datenverarbeitung: Die Datenverarbeitungspraktiken unterscheiden sich je nach Version. Enterprise- und API-Benutzer erhalten erweiterte Datenschutzoptionen, während die Versionen für Privatanwender Daten möglicherweise für Trainingszwecke verwenden und Chats bis zu 30 Tage speichern.

- Sicherheitsprüfungen: ChatGPT wird jährlich einer Sicherheitsprüfung von unabhängigen Cybersicherheitsspezialisten unterzogen, die versuchen, potenzielle Schwachstellen zu ermitteln.

- Bedrohungsüberwachung: Das Bug-Bounty-Programm von ChatGPT ermutigt ethische Hacker, Sicherheitsforscher und Tech-Enthusiasten, nach potenziellen Sicherheitsschwächen oder Fehlern zu suchen und diese zu melden. OpenAI überwacht außerdem kontinuierlich in Echtzeit auf böswillige Aktivitäten, Missbrauchsmuster und Sicherheitslücken.

- Benutzerauthentifizierung: Der Zugriff auf ChatGPT erfordert eine Kontoüberprüfung, Anmeldedaten und sichere HTTPS-Verbindungen, um unbefugte Nutzung bei kostenpflichtigen Tarifen zu verhindern.

- Kontinuierliches Training des KI-Modells: ChatGPT entwickelt seine Plattform kontinuierlich weiter, indem es Modell-Updates und Daten aus Gesprächen (bei allen, die sich dafür entscheiden) verwendet.

So nutzen Sie ChatGPT sicher

Trotz der Sicherheitsmaßnahmen von ChatGPT gibt es, wie bei jedem Online-Tool, Risiken. Hier sind einige wichtige Tipps und Best Practices, um bei der Verwendung von ChatGPT die Sicherheit zu wahren:

- Erstellen Sie ein starkes Passwort für Ihr Konto: Befolgen Sie gute Passwort-Sicherheitspraktiken, indem Sie starke, eindeutige Passwörter erstellen. Idealerweise sollten Sie einen Passwort-Manager nutzen.

- Geben Sie keine sensiblen Daten preis: Denken Sie daran, dass persönliche Details privat bleiben sollten, und geben Sie niemals finanzielle oder andere vertrauliche Informationen während Gesprächen mit ChatGPT preis.

- Glauben Sie der KI nicht blind: Die Antworten von ChatGPT sind nicht immer korrekt. Deshalb gewährleistet nur die Überprüfung zusätzlicher Quellen, dass Informationen nicht falsch, irreführend oder voreingenommen sind.

- Melden Sie problematische Antworten: Das Melden problematischer KI-Ergebnisse hilft, eine Feedbackschleife zu schaffen, die schädliche, verzerrte oder irreführende Inhalte zur Überprüfung kennzeichnet. Dies kann OpenAI helfen, die Antwortgenauigkeit und Objektivität zu verbessern und zukünftige Risiken zu reduzieren.

- Verhindern Sie, dass ChatGPT mit Ihren Daten trainiert: Überprüfen Sie Ihre ChatGPT-Version und deaktivieren Sie das Modelltraining, was dazu beitragen kann, das Risiko von Datenexposition oder dem Durchsickern sensibler Informationen zu verringern.

Lassen Sie sich auch von ausgefeilten KI-Scams nicht täuschen

ChatGPT ist im Allgemeinen sicher in der Nutzung, solange Sie keine sensiblen Daten weitergeben. Aber die eigene Online-Sicherheit erfordert in vielen Bereichen Ihre Aufmerksamkeit. An dieser Stelle kann Norton 360 Deluxe helfen. Es verwendet intelligente Technologie, einschließlich KI-gestützter Erkennung für fortgeschrittene Betrugsversuche, damit Sie leichter feststellen können, ob Sie es mit einem Betrug zu tun haben.

Häufig gestellte Fragen

Ist ChatGPT reguliert?

ChatGPT befindet sich in einer Grauzone mit teilweiser Regulierung. Beispielsweise legt das KI-Gesetz der EU Regeln für Transparenz und Sicherheit fest, aber in den meisten anderen Regionen gibt es noch keine umfassende KI-Regulierung. Es gibt jedoch einige bald in Kraft tretende Bundesgesetze (USA) und freiwillige Richtlinien, die zu befolgen sind.

Ist es sicher, benutzerdefinierte GPTs von Drittanbietern zu verwenden?

Nicht immer. Sie sind dann sicher, wenn Sie den Ersteller überprüfen, wissen, wie er Daten verarbeitet, und es vermeiden, sensible Informationen weiterzugeben. Aber es besteht trotzdem immer die Möglichkeit, dass böswillige benutzerdefinierte GPTs durch die Sicherheitsprotokolle von OpenAI schlüpfen.

Gibt es Beispiele für ChatGPT-Betrug?

Ja, es gibt mehrere GPT-Betrugsbeispiele aus der Praxis: Angreifer, die Benutzer dazu bringen, gefälschte Apps herunterzuladen, die sich als ChatGPT ausgeben; bösartige GPT-Klone, die verwendet werden, um Business-E-Mail-Compromise (BEC)-Angriffe zu starten; und die Nutzung zur Erstellung ausgefeilter Malware.

Sollte ich ChatGPT meinen echten Namen nennen?

Sie sollten nie Ihren Namen oder personenbezogene Informationen mitteilen, da es diese nicht braucht, um Ihnen hilfreiche Antworten zu geben. Die Verwendung eines Vornamens oder eines Pseudonyms funktioniert genauso gut. Es empfiehlt sich, jeden ChatGPT-Chat so zu behandeln, als würden Sie in einem öffentlichen Forum sprechen.

Kann ich ChatGPT zu medizinischen und psychischen Problemen konsultieren?

Sie können ChatGPT allgemeine Fragen zu Gesundheitsthemen stellen, aber es ist kein Ersatz für die Beratung durch einen medizinischen Experten – es kann Ihre spezifische Situation nicht diagnostizieren oder beurteilen. Außerdem könnten seine Antworten ungenau sein, und wenn Sie sich darauf verlassen, könnte das eine angemessene medizinische Versorgung verzögern.

Ist ChatGPT sicher für Kinder?

Nein, Kinder sollten ChatGPT nicht ohne Aufsicht eines Erwachsenen verwenden. Der Bot kann jederzeit unangemessene Antworten generieren oder Kinder auffordern, persönliche Informationen anzugeben.

Ist die Verwendung von ChatGPT bei der Arbeit sicher?

ChatGPT kann für die Arbeit geeignet sein, aber nur, wenn Sie es verantwortungsvoll einsetzen. Füttern Sie es nicht mit Unternehmensgeheimnissen, Kundendaten oder sonstigem, von dem Sie nicht möchten, dass Google es sieht. Stellen Sie sicher, dass Sie ChatGPT im Einklang mit den Unternehmensrichtlinien verwenden, und nutzen Sie, wenn möglich, ChatGPT Enterprise für zusätzliche Sicherheit.

Wenn ich meinen ChatGPT-Verlauf lösche, ist er dann wirklich verschwunden?

Nein, das Löschen Ihres ChatGPT-Verlaufs entfernt ihn nicht sofort aus dem System. Er wird gemäß den Datenaufbewahrungspraktiken von OpenAI 30 Tage lang aufbewahrt, bevor er vollständig gelöscht wird.

Redaktioneller Hinweis: Unsere Artikel enthalten Bildungsinformationen für Sie. Unsere Angebote decken möglicherweise nicht jede Art von Kriminalität, Betrug oder Bedrohung ab, über die wir schreiben, oder schützen davor. Unser Ziel ist es, das Bewusstsein für Cyber Safety zu schärfen. Bitte lesen Sie die vollständigen Bedingungen während der Registrierung oder Einrichtung. Denken Sie daran, dass niemand alle Identitätsdiebstähle oder Cyberkriminalität verhindern kann und dass LifeLock nicht alle Transaktionen in allen Unternehmen überwacht. Die Marken Norton und LifeLock sind Teil von Gen Digital Inc.

Sie möchten mehr erfahren?

Folgen Sie uns, um aktuelle Neuigkeiten, Tipps und Updates zu erhalten.